La multitude au coeur de la politique d’aménagement du territoire

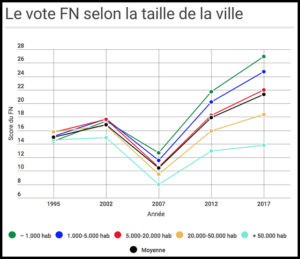

Le 21 avril 2017, au 1er tour de l’élection présidentielle, le parti du Front National est arrivé en tête dans 19.000 communes françaises.

Un vote de protestation ? Il semblerait que non…

Bien que le journal La croix nous rappelle dans un article du 27 avril 2017 (Pourquoi le Front national ne mobilise plus contre lui) qu’en 2002, lorsqu’il avait créé la surprise en se qualifiant pour le 2e tour de l’élection présidentielle, « Jean-Marie Le Pen se complaisait dans son rôle de tribun protestataire », la position du parti auquel appartient Marine Le Pen a sensiblement évolué et ambitionne désormais l’exercice du pouvoir.

La légende ou réalité du vote contestataire a laissé place à une autre analyse : celle du vote d’adhésion. Comme l’indiquent plusieurs articles, désormais, il semble acquis que « le vote FN n’est plus seulement un vote protestataire, [mais] aussi un vote d’adhésion » (Marion Joseph dans Le Figaro du 24/03/2014, Julien Licourt dans Le Figaro du 08/12/2015).

Pour la présidente du parti, Marine Le Pen, le « vote d’adhésion » s’explique facilement : « Ils veulent la révolution de la proximité, davantage de régulation. Ils veulent éviter la loi de la jungle […] ». Extrait d’un article publié le 28 avril 2017 par le journaliste Jacques Paté sur le site de France 3 : « Présidentielle 2017 – Marine Le Pen à Nice veut lancer la révolution de la proximité« .

Le 24 avril 2017, dans un article publié sur le site de France culture (Exode urbain et inégalités : les cartes du vote FN), le journaliste Hérvé Le Bras livrait dans son analyse une corrélation entre les inégalités territoriales et la proportion du vote au profit du front national. Cet article est corroboré par une analyse de Jean-Marie Pottier, sur slate.fr, dans laquelle il met en évidence que « plus on s’éloigne du cœur des aires urbaines, plus on vote FN« .

Le 24 avril 2017, dans un article publié sur le site de France culture (Exode urbain et inégalités : les cartes du vote FN), le journaliste Hérvé Le Bras livrait dans son analyse une corrélation entre les inégalités territoriales et la proportion du vote au profit du front national. Cet article est corroboré par une analyse de Jean-Marie Pottier, sur slate.fr, dans laquelle il met en évidence que « plus on s’éloigne du cœur des aires urbaines, plus on vote FN« .

Dès lors, l’aménagement du territoire représente un enjeu de première importance.

C’est pourquoi, la capacité de l’Etat sinon à assurer l’égalité parfaite, du moins à rechercher l’équité basée sur une politique de transparence et de fédération des bonnes volontés locales apparait comme la meilleure voie pour réduire cette gangrène de la ruralité qui cristallise la désespérance d’une population qui se sent oubliée.

Pour mémoire, le club des maîtres d’ouvrage est un think tank apolitique, son principal objet d’intérêt est la transformation numérique qui s’opère sous nos yeux, touchant la société tout entière et en particulier les entreprises dans lesquelles les adhérents s’investissent.

Pour le Club, il ne s’agit donc pas de mettre à l’index tel ou tel candidat. Il s’agit de s’intéresser aux solutions évoquées lors de nos rencontres : diner/débat, conférence et autres manifestations… pour pointer celles qui sont en lien avec le développement du numérique comme vecteur de progrès pour nos organisations ou la société.

La veille actualité que nous menons régulièrement afin de pouvoir en faire profiter nos adhérents m’a amené à prendre connaissance d’une lettre ouverte aux deux finalistes de la Présidentielle de 2017, dans laquelle des pistes sont proposées pour améliorer les politiques d’aménagement du territoire.

La veille actualité que nous menons régulièrement afin de pouvoir en faire profiter nos adhérents m’a amené à prendre connaissance d’une lettre ouverte aux deux finalistes de la Présidentielle de 2017, dans laquelle des pistes sont proposées pour améliorer les politiques d’aménagement du territoire.

Plusieurs d’entre elles peuvent prendre appui sur des outils numériques et notamment le principe de la multitude que nous évoquons si souvent au sein du Club. C’est justement le cas de la proposition n°9 reprise ci-dessous :

La France numérique n’est-elle pas l’occasion de réduire la fracture entre les grandes métropoles et le reste du territoire ? Peut-elle être le support de concertation citoyenne, d’une force locale au service de son économie territoriale ?

Le numérique est un média qui peut être vertueux et qui peut organiser des circuits courts entre une demande, un besoin et ceux qui peuvent y répondre. Chacun est équipé d’un téléphone portable aux applications multiples, ces dernières répondent à des besoins personnels, il faut, à notre sens, organiser des applications institutionnalisées et territorialisées. Le numérique peut-il être source de décentralisation et de démocratie ?

En 2013 déjà, la Cour des comptes publiait un rapport sur l’organisation territoriale de l’Etat, pointant des défauts de cohérence, de gouvernance et une ressource humaine mal adaptée…

Restreint au périmètre de l’Etat décentralisé, c’est-à-dire sans tenir compte de la réalité des collectivités territoriales, le rapport exposait déjà des pistes de progrès dans le domaine des systèmes d’information :

Accélérer le développement homogène des systèmes d’information et renforcer

l’e-administration

-

donner au secrétariat général du gouvernement (DISIC, aujourd’hui DINSIC) les moyens d’exercer son rôle de pilotage en matière de systèmes d’information, visant à favoriser leur interopérabilité ;

-

substituer aux démarches multiservices le système des plateformes internet, partagées ou partenariales, pour améliorer et simplifier les services aux usagers ;

-

développer toutes les formes de communication numérique comme nouveau moyen de proximité et de simplification des échanges (toutes les attestations administratives).

A l’évidence, le traitement de cette question comporte de nombreuses dimensions, dont l’épineux aspect organisationnel puisque le millefeuille territorial complexifie considérablement la cohérence de l’action et sa gouvernance. Il est cependant permis de penser que des solutions puissent émerger en associant davantage la société civile qui exprime ponctuellement son mécontentement dans les urnes.

L’avènement du digital est un fait dont il faut s’emparer pour créer des opportunités et notamment fluidifier les relations avec l’ambition du multicanal et du crosscanal.

Pour répondre aux enjeux de mutation de la société, le numérique ne doit plus être considéré comme un terme nouveau pour désigner l’informatique du passé. Il ne s’agit plus de scanner des documents pour les injecter dans un outil de gestion électronique de document (GED), démarche qui avait pour seule ambition d’informatiser des processus existants. Il s’agit d’un changement de paradigme. L’opendata, l’opensource, les réseaux sociaux… permettent à chacun d’être contributeur, d’apporter sa valeur pour que la société de demain soit davantage la sienne. A tous les étages d’une organisation publique ou privée, cette inclusion doit désormais être envisagée comme un postulat. Progressons vers l’openrepublic !